当前,全球AI竞赛正从内容生成迈向真实世界的深水区。大模型已不再满足于文本与图像的生成任务,而是加速进化至物理世界的感知、推理与交互能力。据麦肯锡2024年度报告,AI在工业自动化、服务机器人等实体场景的渗透率仍不足15%,其核心瓶颈在于传统模型普遍缺乏三维空间理解、物理规律建模和多模态执行闭环等关键能力——AI仍难真正“走出屏幕”,更难成为实体经济的核心生产力引擎。

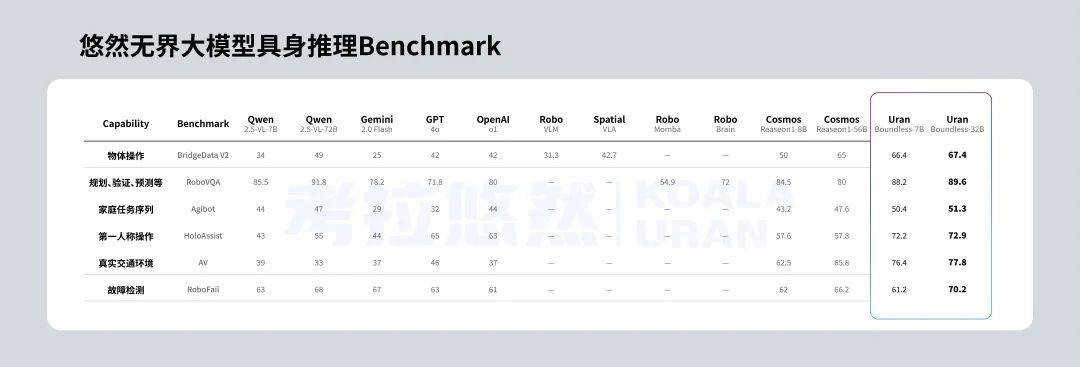

针对这一产业空白,考拉悠然于今年推出了悠然无界大模型(UranBoundlessLargeModel,简称UranBoundless),该模型采用轻量化参数架构,构建出首个面向工业级场景的空间智能闭环系统。其7B与32B两个版本,在最新评测中于多模态理解、物理常识推理、具身执行等核心任务上刷新多项SOTA记录,部分能力甚至超越GPT-4o、Gemini2.5、OpenAI等国际闭源模型,以及Cosmos、Intern、Qwen等开源模型。用远少于现有商业模型的参数量,悠然无界大模型实现了有竞争力的结果,标志着这一国产空间智能多模态模型正式跻身世界第一梯队。这不仅是一项技术的突破,更是AI融入物理世界、深植产业体系的关键跃迁,为智能制造、低空经济等万亿级赛道打开了全新的商业化落地通道。

凭借技术架构与训练方法的全面进化,悠然无界大模型在以下三大核心任务维度实现了代际跃升:

效能跃迁:小体量,大能量

悠然无界大模型7B&32B以小参数结构,在多个空间智能任务中展现出不输甚至超越主流大模型的推理性能,并可稳定运行于消费级GPU上。

这意味着,原本只有高算力平台才能承载的高级AI推理能力,如今已可在嵌入式设备、边缘终端等资源受限环境中落地部署,真正为“AI走进物理世界”打开规模化应用的入口。

能力升维:三大关键任务测评全面领先

01具身推理:操作世界,更稳更准更快

在物体操作(BridgeDataV2)、任务规划(RoboVQA)、真实交通场景(AV)等代表性具身任务中,Boundless-7B在6项任务中全面优于Qwen2.5VL-72B,展现出显著的“小而强”优势。

物体操作(BridgeDataV2):UranBoundless-7B得分66.4,领先Qwen2.5VL-72B近30分。

家庭任务序列(Agibot):UranBoundless-7B以50.4的最高分,全面超越Qwen2.5VL-72B、Gemini2.0在内的所有评测的主流模型。

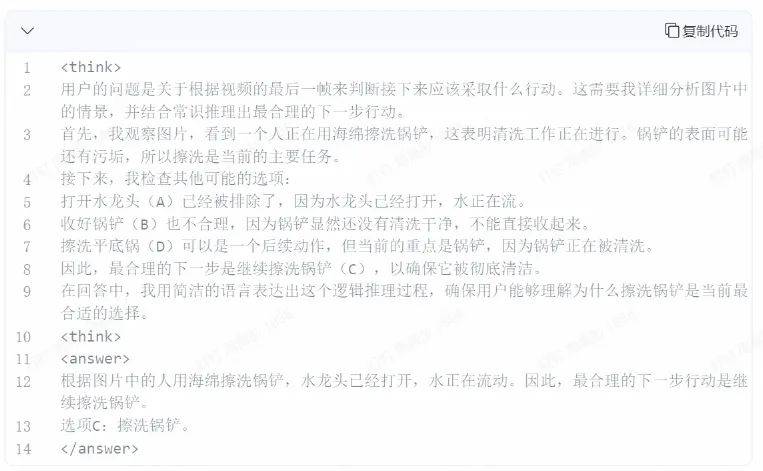

悠然无界大模型通过观察图片环境及人物状态(用海绵擦洗锅铲、水龙头打开水流动),逻辑推理排除选项后得出结果:下一步最合理行动是继续擦洗锅铲。

问题:根据视频中显示的进展以及我在最后一帧的当前观察,为了清洗并收好平底锅和锅铲,接下来我应该采取什么行动?

A.打开水龙头

B.收好锅铲

C.擦洗锅铲

D.擦洗平底锅

第一人称操作(HoloAssist):UranBoundless-7B以72.2分,大幅领先Qwen2.5VL-72B。

这意味着,悠然无界大模型在嵌入式或边缘计算设备上,也能稳定完成复杂物体抓取、路径规划与任务分解,为工业机器人、服务智能体等实际应用提供“轻而强”的空间智能大脑。

02物理常识推理:真实世界的底层规则

悠然无界大模型在基于空间、时间、物理属性等构建的16项细分物理常识能力中,9项表现优于Qwen2.5VL-72B,综合性能远超GPT-4o与Gemini2.0等闭源模型。

空间类(空间关系/可行性/环境理解):UranBoundless-7B在“空间关系”“环境理解”等所有测评任务中均超越Gemini2.0得分,表现出对物体之间相对位置与约束逻辑的准确建模。

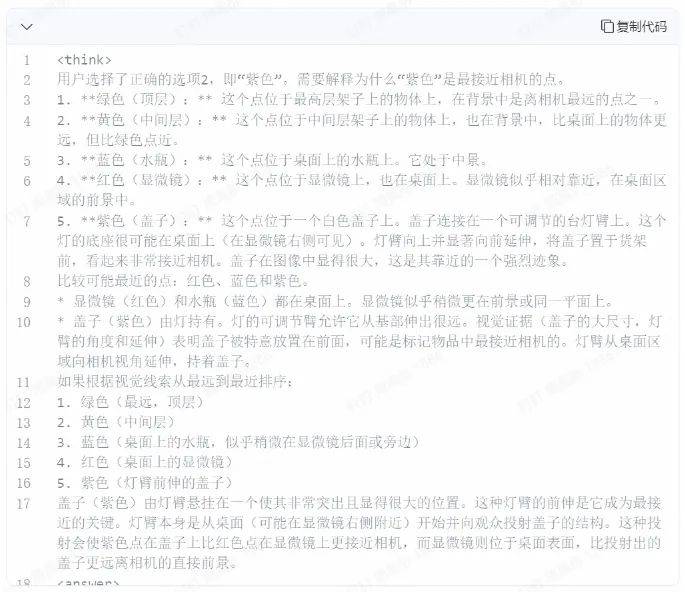

悠然无界大模型通过识别图像中物体的空间关系,根据视觉线索将物体进行从最远到最近的准确排序。

问题:图像中,哪个颜色的点离摄像机最近?

A黄色;B绿色;C紫色;D红色;E蓝色

时间类(动作/顺序/因果性/计划):在“动作因果性判断”“动作顺序规划”等所有测评任务上,UranBoundless-7B刷新纪录,全面领先OpenAIo1、GPT4o。

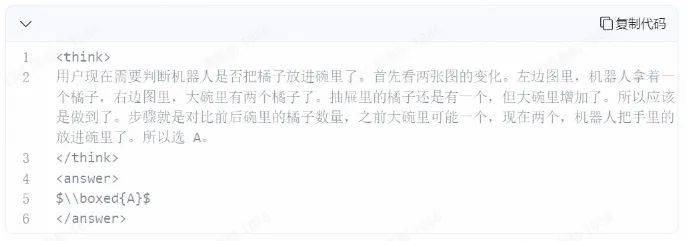

悠然无界大模型通过识别两张图的变化,对比前后碗里的橘子数量,以及机器人的状态,判断推理出任务的完成情况。

问题:把橘子放在碗中,请问做到了吗?

A.做到了;B.没做到

在多步骤空间操作中,悠然无界大模型不仅能判断路径可达性,更能综合分析摩擦力、障碍布局与动作顺序,生成可执行的动作链。这种类人类的物理直觉与逻辑判断力,正是数字孪生、城市治理等高约束场景所需的关键能力。

03多模态理解与推理:从“看懂图文”到“看懂世界”

在最新多模态理解基准评测中,悠然无界大模型(UranBoundless-32B)在视觉、语言、视频、数学、OCR等多模态场景任务中取得领先,在MMMU、MMBench、AIME等多个权威测试中跻身世界一流梯队,标志着国产模型已在多模态推理能力上实现突破。

在视频、图文、语义等复杂多模态融合任务中,UranBoundless-7B&32B同样展现出强劲竞争力:

推理任务:UranBoundless-32B在MMMU和MMMU-Pro任务中分别取得77.4/52.3分,展现出优异的跨图文深度推理能力。

视频理解任务:在MMVU和VideoMathQA任务中以63.2/38.3分,领先国内主流开源模型,具备强大的视觉与时序建模能力。

文本推理任务:在AIME2024、AIME2025任务中分别获得85.3/74.4分,逼近甚至超越GPT-4o,表现出极强的链式思维表达与复杂文本理解能力。

OCR:在ocr-reasoning中得分37.85,全面领先Gemini2.5、OpenAIo3等国际顶尖闭源模型,以及所有主流开源模型,成为该任务中表现最强的模型。

这意味着,悠然无界大模型已经具备面向视频理解、图像语义融合、跨模态时空推理等任务的行业部署能力,特别适用于智慧交通、应急抢险、工业检测等高实时性多模态场景。

技术底座:小而强,一整套高效训练范式

悠然无界大模型在底层训练方法上进行了系统性重构。我们通过架构优化+三阶段训练+快慢结合思维机制,打造出专为空间智能而生的小参数大能力。

01训练推理一体化框架

统一的多模态训练推理框架:构建了集数据处理、模型训练、推理优化于一体的端到端技术栈,采用模块化设计支持多种模态输入和任务类型,通过统一的接口规范实现训练阶段与推理阶段的无缝衔接,显著降低模型部署复杂度和运维成本。

动态负载均衡与资源优化:采用混合控制器编程模型,解耦推理过程数据收集与训练过程大规模参数更新的数据依赖,同时支持各种模型在不同GPU集合上的放置,实现高效资源利用和跨不同集群规模的可扩展性。

这一体系让悠然无界大模型在不同应用场景下都具备良好的可扩展性和稳定性,也让“小参数”不再是“小作坊”,而是可工业级部署的智能底座。

02三阶段训练方法

悠然无界大模型模型能力的跃升,得益于一套从“感知”到“理解”再到“推理”的多阶段训练路径,具体包括:

多模态预训练:让模型“看懂世界”,实现图文、视频等不同模态之间的语义统一。

指令微调:像教学生一样教AI理解任务意图,形成结构化的多模态理解能力。

推理强化学习:引入一整套“智能自学机制”,让模型在复杂问题中不断优化解题思路,形成稳定的空间推理与因果判断能力。

其中,我们特别引入了三大创新机制,帮助模型在复杂空间任务中持续进化:

智能数据筛选机制:模型能“判断题目难度”,始终在自己认知边界附近训练,既能快速成长,又避免无效学习。

动态经验采样机制:像人类一样“总结经验”,保留高质量解法,剔除无效路径,提升推理多样性。

熵正则化机制:控制训练中的“探索节奏”,确保每次训练都有效果,既快又稳。

这套方法,实测在多个具身推理与视频理解任务中显著提升推理能力,在复杂任务准确率上突破80%,推理效率提升59.9%。

03快慢结合推理能力

面对现实世界的复杂场景,有时需要“快反应”,有时需要“慢思考”。悠然无界大模型在架构上创新引入了双系统思维机制:

简单问题,模型可走System1快路径,快速给出响应;

复杂场景,则切换至System2慢路径,进行链式推理与因果分析。

此外,我们将强化学习数据组织为“思维链”格式(Chain-of-Thought),每一步推理逻辑清晰透明,既可解释又易控,特别适用于空间规划、任务拆解、物体操控等需要“多步走”的任务类型。

空间智能闭环,从模型走向场景

悠然无界大模型不仅在多项权威技术评测中跑赢主流大模型,更正在以轻量参数+强泛化能力,加速走进真实场景,成为空间智能真正可落地的“轻引擎”。其小体量、强性能的特性,使其可部署于边缘计算节点、轻量机器人、工业智能体等场景:

在复杂工业现场,它支持智能卸货机器人完成动态避障与路径规划;在城市交通与公共服务中,赋能空间智能巡检机器人自主完成电力巡检任务;在服务业领域,实现自适应的导购机器人与用户实时多模态互动;在智慧城市治理中,构建多模态交互平台,支撑应急响应、多智能体协同调度等关键场景——一套从模型到智能体,再到场景生态的空间智能体系,正由考拉悠然稳步铺展。

如董事长申恒涛院士所言:

AI的真正落地,必须实现数字世界与物理世界的融合。我们希望通过悠然无界大模型,对齐不同空间、任务与智能体本体,赋予AI跨场景的泛化推理与行动能力。

让AI轻装上阵,走进真实世界

在大模型竞赛日趋激烈的当下,考拉悠然选择了另一条路径:以架构革新和训练方法重构为支点,撬动“小参数大能力”的新范式。悠然无界大模型通过高效、精密、可控的三阶段训练体系,让模型释放出空间智能能力,用性能突破,打破参数规模的天花板。

这不仅是技术效率的飞跃,更是AI迈入真实世界的关键一步。在更小的计算资源、更低的部署门槛下,AI第一次拥有了真正理解空间、感知物理、执行任务的能力。

作为多模态世界模型与空间智能的引领者,考拉悠然将继续以“技术顶天、应用立地”为发展准则,推动AI从代码跃入场景,从数字跃入物理,真正走进城市、工厂与万物之间的人机共生新纪元。

客户端

客户端

媒体矩阵

媒体矩阵

企业邮箱

企业邮箱